微软为“VR环境”骚扰提出“毒性屏障”审查机制,过滤VR世界不良行为

文章相关引用及参考:映维网

只会在用户感到不舒适的情况下才进行审查。

(映维网 2019年02月18日)网络暴力是企业一直希望解决的问题,而一些企业甚至利用了机器学习等人工智能方式。在某些情况下,虚拟环境有可能会加剧这类事件对用户的心理影响。但是,有意见认为“有毒”的定义因人而异。例如,某些用于咒骂的词语对不同人而言有着不同的解读。

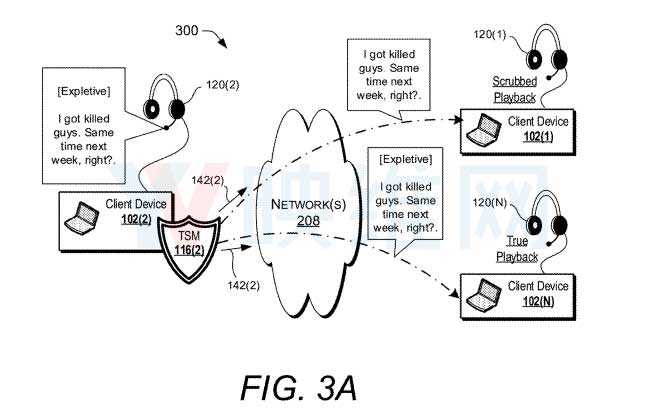

微软认为这是多用户环境中需要解决的一个问题。在美国专利商标局日前公布的一份文件中,这家科技公司设想了一个个性化的“毒性屏障”,其可以根据用户的喜好监控通信和审查数据。

名为“Personalized toxicity shield for multiuser virtual environments(多用户虚拟环境中的个人毒性屏障)”的发明文件指出,通信可以包括基于语音或基于文本的聊天,如多人游戏会话中的聊天,或者这可以扩展至视频数据流中的图形显示。另外,这一系统可以成为在线Web会议或VR/AR会话的组成元素。所述的技术基本上可以帮助用户有效地与多人进行通信交流,同时可以防止特定的用户成为其烦恼的来源。

但毒性屏障模块所监控的内容并不仅仅局限于咒骂,同时可能包括不良行为,如朝麦克风大力喷气,或者过于靠近用户。某些人认为,全面禁止这些特定动作显得过于苛刻,所以专利描述的系统只会在用户感到不舒适的情况下才进行审查。

对于毒性屏障的工作原理,系统可以分析“容忍度数据”以部署特定于用户的毒性屏障模块(TSM)。TSM同时可以利用通过机器学习引擎生成的预测模型来阻隔相关的行为(这一模型可以分析学习用户对不良行为的反应)。系统可以选择默认配置文件以向引擎提供其所需的一切信息,而用户可以选择手动设置设置。这样,系统将能够“基本上实时地”通过静音,删除或不播放不需要的数据来应对不良行为。在某些情况下,它可以向不良行为者发送警告信息或暂停与他们的所有通信。

相关专利:Personalized toxicity shield for multiuser virtual environments

如果能够实现真正的智能执行,这样的系统有望营造一个适宜的多用户在线环境。但当然,理想的网络环境定义因人而异,而且实现起来总是充满着挑战。“Personalized toxicity shield for multiuser virtual environments(多用户虚拟环境中的个人毒性屏障)”这份专利是于2017年8月提交,并于日前由美国专利商标局正式公布。需要注意的是,这仅仅只是一份专利,仅代表微软朝这一方向进行了探索,尚不确定他们是否会或将于何时商业化相关的技术发明。