Oculus Quest手部追踪正式推出,让新人更轻松步入VR

将在2020年继续添加新的功能以改善Quest的手部追踪体验

(映维网 2019年12月10日)从执行手势和与别人交流,到拾取和操纵物体,双手在与世界交互的过程中扮演着重要角色,而它们同时使解锁虚拟空间中真实临场感的关键。为了增强VR的自然感和直观性,Oculus首先通过Oculus Touch控制器将用户的双手带到了虚拟现实。现在,Oculus Quest即将能够支持手部追踪功能。这是支持你通过真实双手在VR中交互的下一步发展。尽管公司把初始发布日期定为2020年初,但他们一直致力于尽早将这一新功能带来大家。

Oculus将从本周开始为Quest用户带来抢先体验版的手部追踪功能,并在下周向开发者提供SDK。你只需将Quest的软件更新到v12,然后在“Experimental Features(实验功能)”菜单中启用即可抢先试用。在本周的发行版中,你可以直接用双手导航Home界面(如“内容库”和“Oculus Store”),以及精选的第一方应用程序(如Oculus Browser和Oculus TV)。你甚至可以用双手来设置防护边界的地板高度,无需任何控制器。要在双手和触摸控制器之间切换,你可以利用Oculus Home菜单中的全新切换开关。

Oculus指出:“我们希望手部追踪技术能够消除学习控制器功能的需求,这样新人就能够更轻松地尝试VR。对于已经拥有Quest的用户,当控制硬件消失时,你可以完全沉浸在VR的魔法之中中,同时以无缝,直观的方式与他人联系。”

至于开发者,你可以通过全新的SDK为VR建立新一代的无控制器体验,开发者和创作者现在可以首次解锁基于手控的Quest应用。从社交应用程序中更具表现力的手势,到业务培训模块中更高效的工作流程,相信开发者将会给我们带来各种更为自然和直观的体验。

Oculus表示:“手部追踪可进一步提升临场感,增强社交参与度,并在VR中提供更直观的交互。它为开发者增加了一个全新的输入选项。当然,对于需要高精度、触觉反馈和利用物理输入能力的多种游戏体验而言,Touch控制器依然是理想的选择。我们相信,借助这一新选项,VR的未来会更加光明,因为它扩大了内容的可能性。我们期待看到你在2020年及以后的畅想。”

从下周开始,开发者可以利用更新的API来构建支持手部追踪功能的Quest应用程序,比如说VrAPI。所述API现在包括三个手部姿势函数:vrapi_GetHandSkeleton,vrapi_GetHandPose和vrapi_GetHandMesh。Oculus将在下周提供所述的新版API,原生SDK和Unity集成,而UE4集成在定于2020年上半年。这家公司提供的内容同时包含一个Unity示例,其旨在向你说明如何利用OVRInput创建手部追踪体验。

随着你构建搭载手部追踪功能的新内容,Oculus将开始允许你在2020年1月开始将游戏/应用带到Oculus Store,提交和审核流程与当前一样。

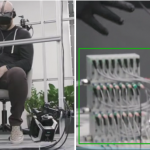

为了令这一切成为可能,Oculus的计算机视觉团队开发了一种应用深度学习的全新方法,仅使用Quest内置的单色摄像头来理解手指的位置,不需要有源深度感应摄像头、其他传感器或处理器。相反,他们结合了深度学习与基于模型的追踪来估算用户手部的位置和大小,然后在3D模型中重建手部和手指的“姿态”。这一切都由移动处理器处理,不会减损专用于程序的资源。下面这个视频是OC6期间Oculus产品与工程团队对手部追踪的介绍:

如果你希望进一步了解有关设计手控游戏/应用的信息,请参阅Talespin和Magnopus的以下演讲。他们根据自己的手控应用提供了相关的案例研究(分别为American Farmers Insurance和Elixir开发的内容,而且在OC6的展厅进行了演示)。

无论是新加入VR社区的新人亦或是首次接触无控制器输入的成员,相信Oculus的手部追踪将会给你一种别致的体验。随着越来越多的内容开始支持手控功能,这将成为Facebook/Oculus给VR行业带来的最美好的礼物之一。这家公司表示,这仅仅只是开始,将在2020年继续添加新的功能以改善Quest的手部追踪体验。如需更多信息,你可以留意映维网后续中关于v12版本的说明。