CVPR 2020 AR/VR板块CV4ARVR科研论文汇总

查看引用/信息源请点击:映维网

增强现实/虚拟现实领域的论文

(映维网 2020年06月22日)2020年计算机视觉和模式识别大会(Conference on Computer Vision and Pattern Recognition;CVPR)正在如火如荼地进行中,来自世界各地的计算机视觉研究者和工程师都在这里分享最新的进展。

下面是增强现实/虚拟现实领域论坛的的论文及相关摘要整理(点击标题可下载论文):

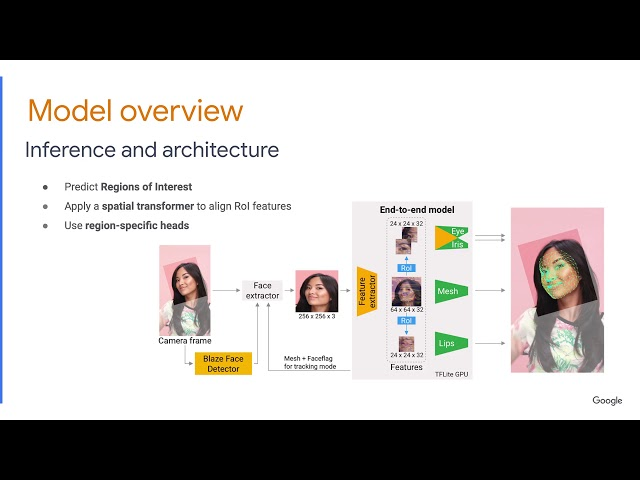

1. Attention Mesh: High-fidelity Face Mesh Prediction in Real-time

By: Google Research

我们提出了一种用于三维人脸网格预测的轻量级架构Attention Mesh,而它主要是利用用户对语义意义区域的注意。我们的神经网络是为实时设备端推断而设计,它能够在Pixel 2以超过50 FPS的速度运行。我们的解决方案能够赋能诸如AR化妆,眼动追踪和AR操纵等需要眼睛和嘴唇区域提供高精确特征的应用。我们的主要贡献是一个统一的网络架构,它在提供面部特征方面达到了与多级级联方法相同的精度,而且速度提高了30%。

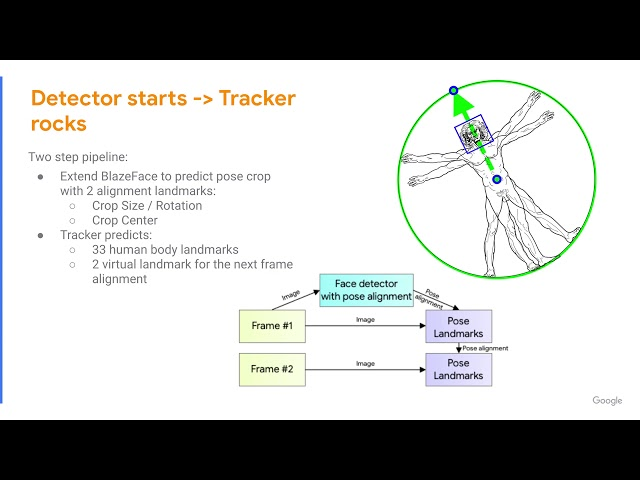

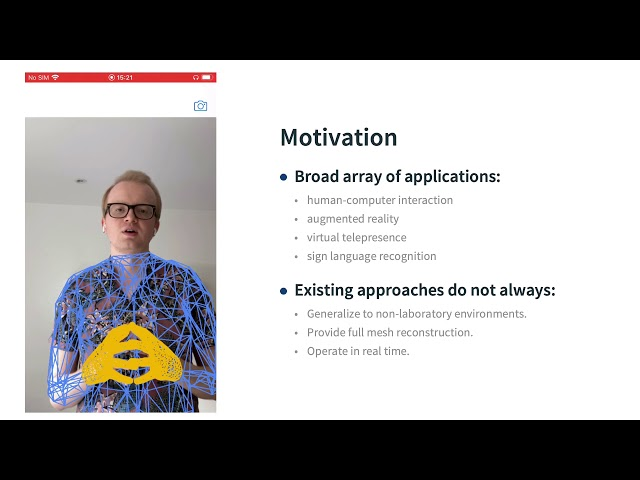

2. BlazePose: On-device Real-time Body Pose tracking

By: Google Research

我们提出了一种用于移动设备进行实时推理的轻量级卷积神经网络架构BlazePose。在推断过程中,网络会为人体生成33个身体关键点,并在Pixel 2以30 FPS的速度运行。这使得它特别适合贴合度追踪和手语识别等实时用例。我们的主要贡献包括一个使用热图和关键点回归的全新身体姿态追踪解决方案和轻量级身体姿态估计神经网络。

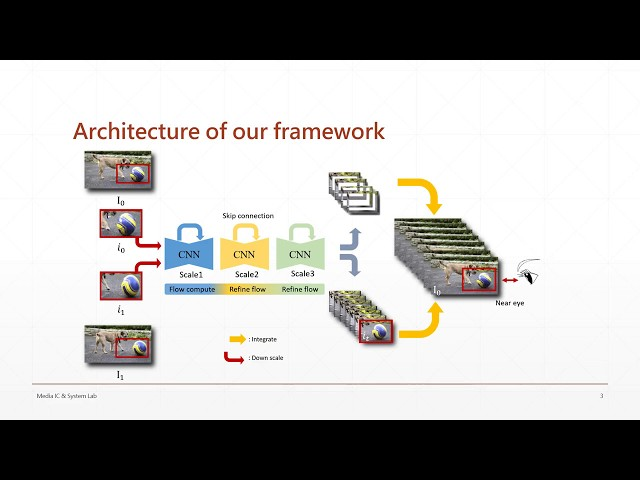

3. Boosting Perceptual Resolution of VR Displays

By:National Taiwan University

由于当前头显像素密度不足,难以实现VR应用所要提供的完全沉浸式体验。我们在这项研究中提出了一个能够以合理的计算成本提高VR显示器感知分辨率的框架。所提出的视觉框架合成网络能够产生高分辨率的信息,然后通过视网膜的整合过程来恢复高分辨率视觉。另外,我们同时提出了一种在同一帧中混合帧率区域的方法,这可允许我们只在注视点区域改善感知体验。我们通过主观实验验证了框架的有效性。

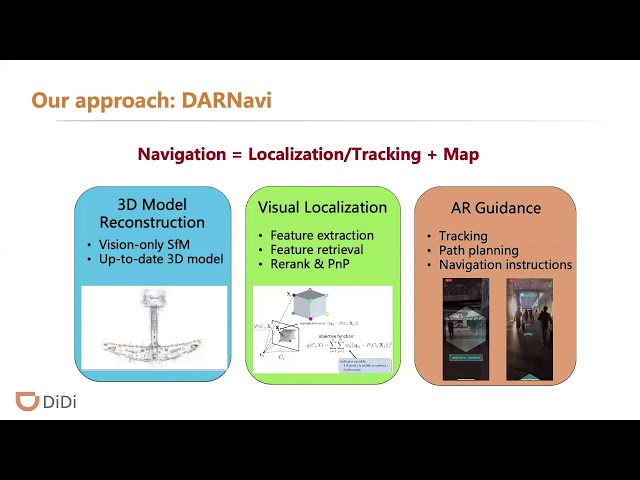

4. DARNavi: An Indoor-Outdoor Immersive Navigation System with Augmented Reality

By:滴滴出行

线上打车服务在全世界都备受欢迎。有效地引导乘客到达乘车点可以节省寻路时间并提高整体用户体验。这对线上打车服务具有重要意义。我们提出了一种用于引导乘客从室内位置到达乘车点的沉浸式导航系统。在导航过程中,系统支持使用增强现实技术将导航元素真实地呈现到物理世界中。所述系统已经部署在普通手机的商业应用程序中,并已经为数千名乘客提供过服务。

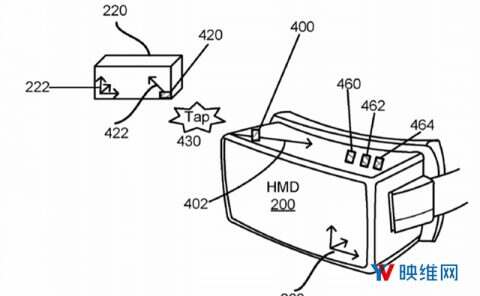

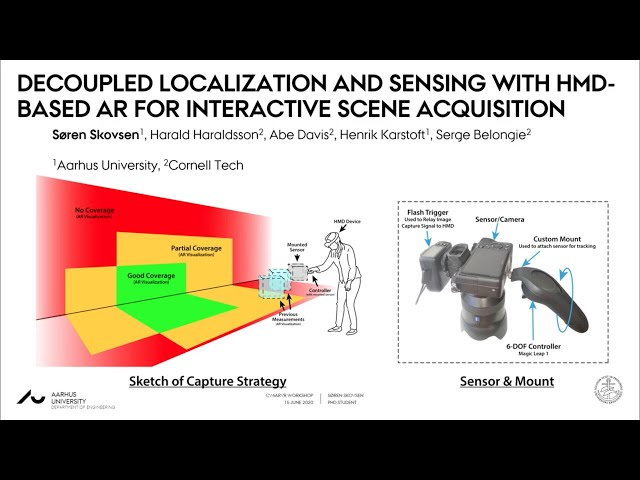

5. Decoupled Localization and Sensing with HMD-based AR for Interactive Scene Acquisition

By:Serge Belongie,Cornell Tech

对于实时追踪和视觉反馈所提供的交互式AR辅助式捕获系统,其可作为专用传感器装置和机器人龙门架的一种便捷的和低成本的替代品。我们提出了一种将所述应用中的定位和视觉反馈与用于捕捉场景的主传感器分离的简易策略。我们的策略是使用AR头显和六自由度控制器进行追踪和反馈,并与单独的主传感器同步捕捉场景。在这篇论文中,我们提出了关于所述策略的原型实现,并通过将运行时姿态估计值与高分辨率离线SfM的结果进行比较来研究解耦追踪的精度。

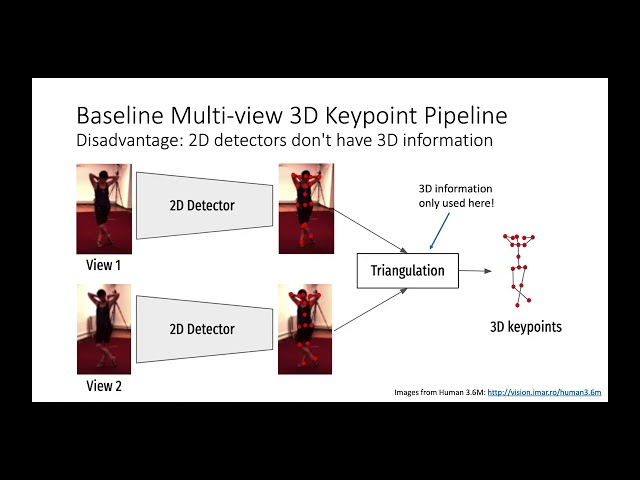

6. Epipolar Transformer for Multi-view Pose Estimation

By:Facebook,Carnegie Mellon University

在同步和校准的多视图设置中,定位三维人体关节的常用方法包括两个步骤:1.分别在每个视图应用二维检测器来定位二维关节;2.对每个视图中的二维检测执行鲁棒三角剖分以获取三维关节位置。但在步骤1中,二维检测器仅限于解决可能在三维中能更好解决的挑战性情况,如遮挡和斜视角,亦即纯粹在二维中而不利用任何三维信息。所以我们提出了可微的“极线变换器”,这使得二维探测器能够利用三维感知特征来改进二维姿势估计。原理是:给定当前视图中的二维位置p,我们希望首先在相邻视图中找到其对应的点p0,然后将p0处的特征与p处的特征相结合,从而在p处产生一个三维感知特征。受立体匹配启发,极线变换器利用极线约束和特征匹配来逼近p0处的特征。InterHand和Human3.6M的实验表明,我们的方法比基线有一致的改进。具体来说,在不使用外部数据的情况下,我们使用ResNet-50 backbone和256×256图像大小训练的Human3.6M模型在性能方面比现有模型高4.23mm,达到了MPJPE 26.9mm。

7. Fakeye: Sky Augmentation with Real-time Sky Segmentation and Texture Blending

By:University of Science, VNU-HCM

增强现实技术已经广泛应用于增强人类的体验。除了提供真实环境感知外,它同时可以提供人工内容。尽管大多数AR应用都专注于服务于室内任务,但为了创建一个更完整的虚拟环境,诸如天空这样更高、更广阔的空间同样应该受到关注。由于远距离目标在渲染方面的表现与近距离目标不同,本文尝试设计一种用虚拟对象来增强天空的方法,并同时解决实时天空分割以产生遮挡错觉,真实场景与虚拟场景融合,以及摄像头对准等难题。我们的移动实现方法名为“Fakeye”,它产生了富有前景的结果,并带来了令人兴奋的体验。

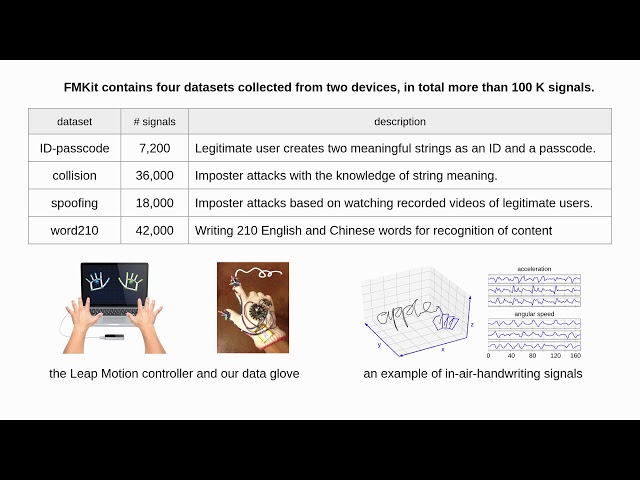

8. FMKit – An In-Air-Handwriting Analysis Library and Data Repository

By:Arizona State University

对于用户无法使用物理键盘或触控屏的增强现实和虚拟现实应用,手势和悬空书写输入了替代的信息提供方法。然而,理解手部和手指的运动是一个挑战,这需要大量的数据及数据驱动模型。本文提出了一个用于悬空书写的公开研究FMKit。它包含一组Python库和一个数据存储库。其中,我们使用两种不同的动捕传感器对180多名用户进行了数据采集。我们同时介绍了FMKit支持的三个研究任务,包括基于悬空比划的用户认证、用户识别和单词识别,以及初步的基线性能表现。

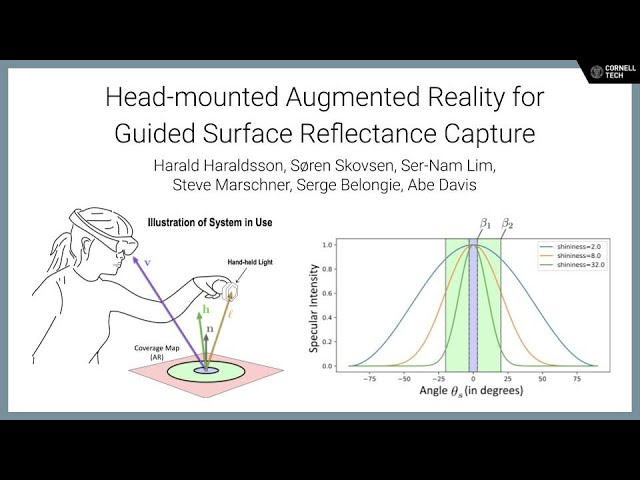

9. Head-mounted Augmented Reality for Guided Surface Reflectance Capture

By:Cornell Tech,Aarhus University,Facebook AI,Cornell University

我们在这个项目中探索了一种系统设计,用一个AR头显和一个手持控制器帮助用户捕捉表面反射函数。我们补充了在捕捉过程中追踪的一个标准六自由度控制器与一个可安装光源。用户首先使用控制器选择要捕获的表面区域。然后我们通过头戴式摄像头记录图像,同时通过AR显示屏的实时反馈引导用户控制手持式光源。我们的系统提供了一种获取表面反射率信息的简单而有效的方法。

10. Holopix50k: A Large-Scale In-the-wild Stereo Image Dataset

By:Leia Inc

随着双摄像头手机在市场中广泛应用,利用计算机视觉中的立体信息对AR/VR行业变得越来越重要。目前最先进的方法主要是利用基于学习的算法,其中训练样本的数量和质量严重影响结果。现有的立体图像数据集无论在大小还是种类方面都受到限制。所以,基于所述数据集训练的算法不能很好地推广到移动摄影遇到的场景。本文提出了一种新颖的立体图像数据集Holopix50k,其包含由Holopix移动社交平台用户贡献的49368对图像。在这项研究中,我们描述了我们的数据收集过程,并将我们的数据集与其他流行的立体数据集进行了统计比较。实验表明,使用我们的数据集可以显著提高立体超分辨率等任务的结果。最后,我们展示了数据集在训练神经网络预测立体图像和单目图像视差图方面的实际应用。高质量的视差图对于提高手机AR/VR应用的投影效果和三维重建效果至关重要。

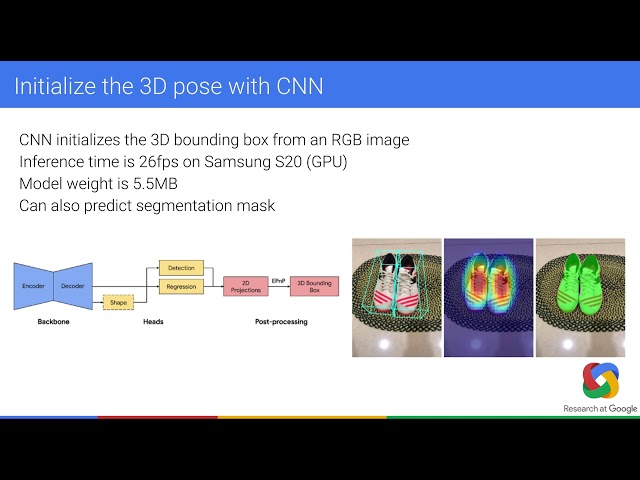

11. Instant 3D Object Tracking with Applications in Augmented Reality

By:Matthias Grundmann,Google Research

三维对象姿态追踪是增强现实应用中的一个重要组成部分。我们提出了一个即时运动追踪系统,它可以在移动设备实时追踪对象在空间中的姿态(以三维方框盒表示)。我们的系统不需要任何事先的感官校准或初始化才能正常工作。我们使用一个深神经网络来检测对象并估计其初始三维姿态,然后利用一个鲁棒的平面追踪器来追踪估计的姿态。我们的追踪器能够在移动设备实时执行相对尺度的九自由度追踪。通过有效地结合CPU和GPU,我们在移动设备实现了26-FPS+的性能。

12. MediaPipe Hands: On-device Real-time Hand Tracking

By:Google Research

我们提出了一个实时的设备端手部追踪管道,它可以利用单个RGB摄像头为AR/VR应用预测手部骨骼。所述管道由两个模型组成:1.手掌探测器,2.手部特征模型。它是通过MediaPipe实现,而MediaPipe是一个构建跨平台ML解决方案的框架。所述模型和管道结构在移动GPU上具有很高的实时推理速度和预测质量。MediaPipe Hands的开源代码请参见https://mediapipe.dev。

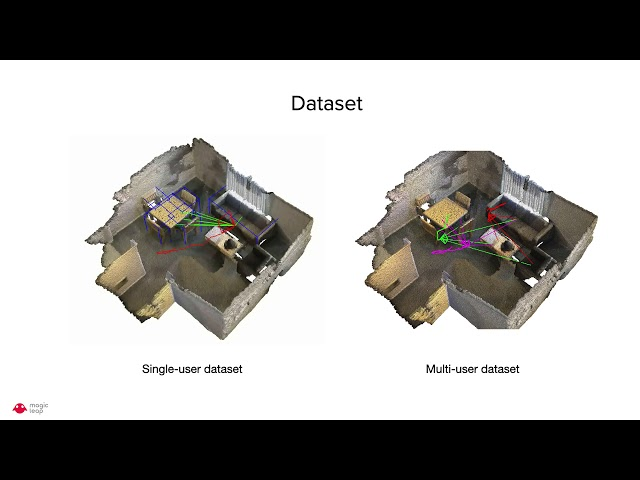

13. Multi-user, Scalable 3D Object Detection in AR Cloud

By:Magic Leap

随着AR云变得越来越重要,一个关键的挑战是大规模的多用户3D目标检测。目前的方法通常侧重于单个房间和单名用户场景。本文提出了一种基于分布式数据关联与融合的多用户可扩展三维目标检测方法。我们使用现成的检测器来检测2D中的对象实例,然后在3D中对每个对象进行组合,同时允许对映射进行异步更新。分布式数据关联和融合允许我们同时将检测扩展到大量用户,同时保持较低的内存占用而且不损失准确性。我们展示了相关的经验结果,其中分布式方法在ScanNet数据集上达到了可比拟集中式方法的精度,而且将内存消耗减少了15倍。

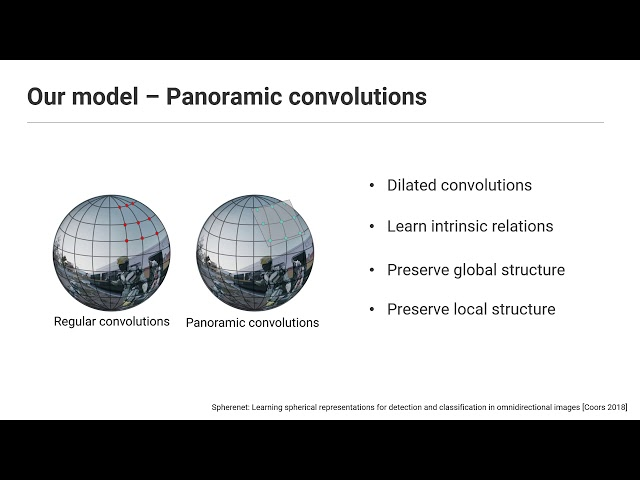

14. Panoramic convolutions for 360º single-image saliency prediction

By:Universidad de Zaragoza,I3A

我们提出了一种基于全景卷积的卷积神经网络,并主要用于360度等矩全景图的显著性预测。我们的网络架构利用了最近提出的360度感知卷积进行设计,所述卷积将内核表示为与全景投影所在的球体相切的面片,并且使用一个根据每个像素在日昝投影中的坐标来惩罚预测误差的球形损失函数。我们的模型成功地从单个图像预测360度场景中的显著性,在全景内容方面的性能优于其他最新方法,并且产生了可能有助于理解用户在查看360度虚拟现实内容时的行为的更精确结果。

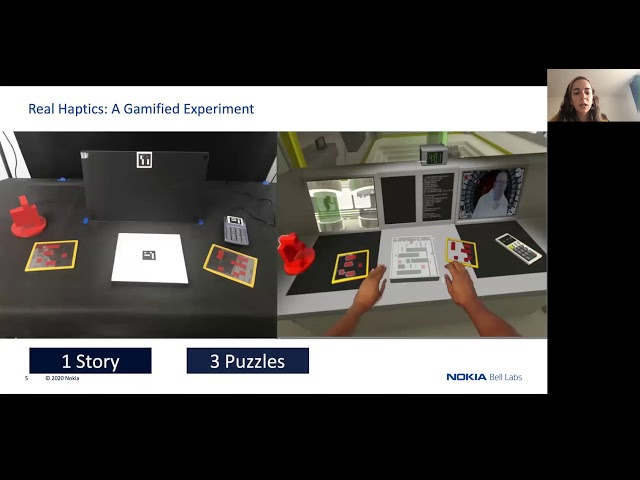

15. Realistic Training in VR using Physical Manipulation

By:Nokia Bell-Labs

我们之前在IEEE虚拟现实研讨会中提出了一种直接应用于训练应用的混合现实交互方法。它基于两个关键思想的结合:通过分割用户真实双手来在虚拟空间中提供真实的用户具现,并允许在沉浸式场景中操纵可能保留或改变其真实外观的物理对象。对于所述概念的部署,我们在基础场景使用了Unity部,以及基于颜色的对象分割算法和用于对象追踪的Aruco库。然后,为了利用游戏化的优势,我们构建了一个5分钟的逃生室游戏来验证所有组件:真实的具现,真实的对象,增强的真实对象和控制设备。我们通过53名用户对系统进行了全面的评估,并制定了一个公平的比较方案:每个用户必须玩两次逃生室,一次是使用真实对象和双手,另一次是纯虚拟对象和虚拟化身。在完成测试后,用户必须回答一份衡量用户临场感,具现感和体验质量的标准问卷调查。另外,我们从游戏运行中提取了与性能相关的定量数据。结果验证了我们的假设,亦即这种方法显著地改善了关键因素,如相对于对应虚拟现实解决方案的临场感或具现感。我们预计我们的解决方案将为虚拟培训应用程序的实现提供重大进展。

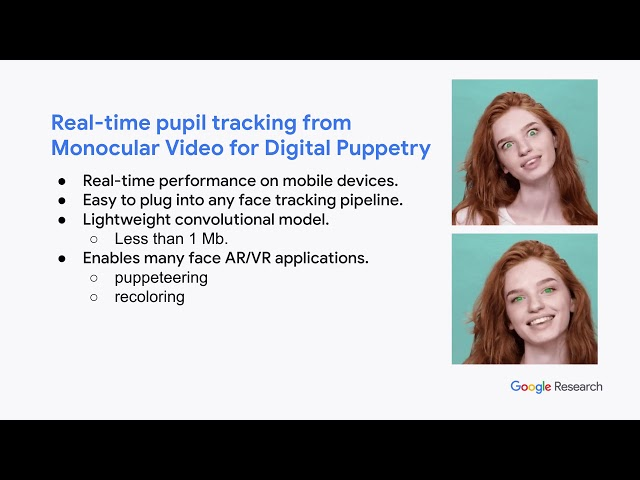

16. Real-time Pupil Tracking from Monocular Video for Digital Puppetry

By:Google Research

我们提出了一种由移动设备的实时视频追踪瞳孔的简单实时方法。我们的方法扩展了一个最先进的人脸网格检测器。所述检测器由两个新组件组成:一个可以在二维预测瞳孔位置的微小神经网络;另一个是基于位移的瞳孔混合形状系数估计。我们的技术可以用来精确地控制虚拟木偶的瞳孔运动,从而给它带来生命力。所述方法在现代手机的运行速度超过50 FPS,并且可以用于任何实时木偶制作管道。

17. Real-time Retinal Localization for Eye-tracking in Head-mounted Displays

By:Univerisity of Washington, Magic Leap

在头戴式显示器中,精确的和鲁棒的眼动追踪非常关键。本文研究了一种利用视网膜运动视频来估计眼睛注视点的方法。我们将视网膜运动视频的每一帧定位在一幅马赛克大视场搜索图像中。定位是基于卡尔曼滤波进行,它在估计过程中嵌入深度学习,并以图像配准为测量手段。所述算法在实验中得到了验证。在实验中,视网膜运动视频是从一个动态的真实体模中获取。除标注误差外,算法的平均定位精度为0.68°。传统的瞳孔闪烁眼动追踪方法的平均误差为0.5°-1°,而使用视网膜视频的眼动追踪分辨率为每像素0.05°,比瞳孔闪烁方法优胜近20倍。对于这个天生鲁棒的方法,其精度有望随着进一步的开发而提高。

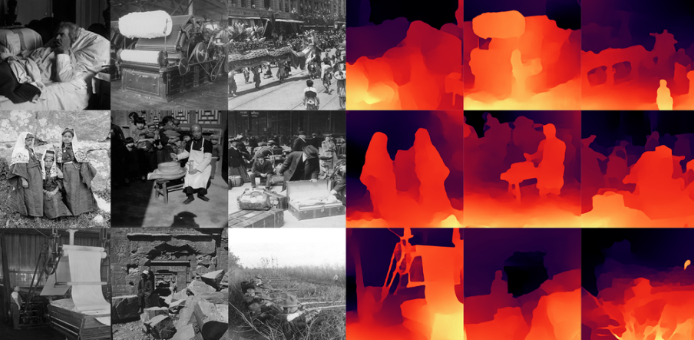

18. Slow Glass: Visualizing History in 3D

By:University of Washington,Google

我们介绍了在三维中重建和查看古旧立体图的新技术。利用来自加利福尼亚摄影博物馆的Keystone Mast图像集,我们通过多个处理步骤来生成清晰立体图对,包括校准数据,校正变换和视差图。我们描述了一种从以实时速率在移动设备运行的场景中合成新视图的方法,模拟了通过打开窗口查看这些历史场景的体验。

19. Weakly-Supervised Mesh-Convolutional Hand Reconstruction in the Wild

By:Ariel AI, Twitter

我们介绍了一种简单有效的单目三维手部姿态估计网络架构。所述网络架构由图像编码器和网格卷积解码器组成,并通过直接的三维手部网格重建损失进行训练。我们在YouTube视频中收集一个大规模的手部动作数据集来训练我们的网络,并将其用作弱监督的来源。我们基于弱监督网格卷积的系统在很大程度上优于最新的方法,甚至可以将原始基准上的错误减半。最终的网络将通过在移动手机运行的实时多人手姿势估计演示内容进行展示。